責任あるAI利用

学術論文執筆での生成AI利用の倫理について正しく知るために

AI時代における論文執筆者の疑問

01論文原稿の執筆に生成AIを利用してもよいのか?

02原稿のどの部分でどのようにであれば、AIを利用できるのか?

03論文著者の責任とは何か?

04AI使用に関する出版社の指針に抵触していないか?

05どのようなかたちの人による原稿チェックが必要か?

AI時代の論文著者の責任

01人による

原稿チェックの

実施

生成AIを少しでも使用した論文原稿は、投稿前に人の目でチェックする必要があります。AIによる意味・内容の改変のないことを、原稿の学術領域および言語の専門家が確認しなければなりません。

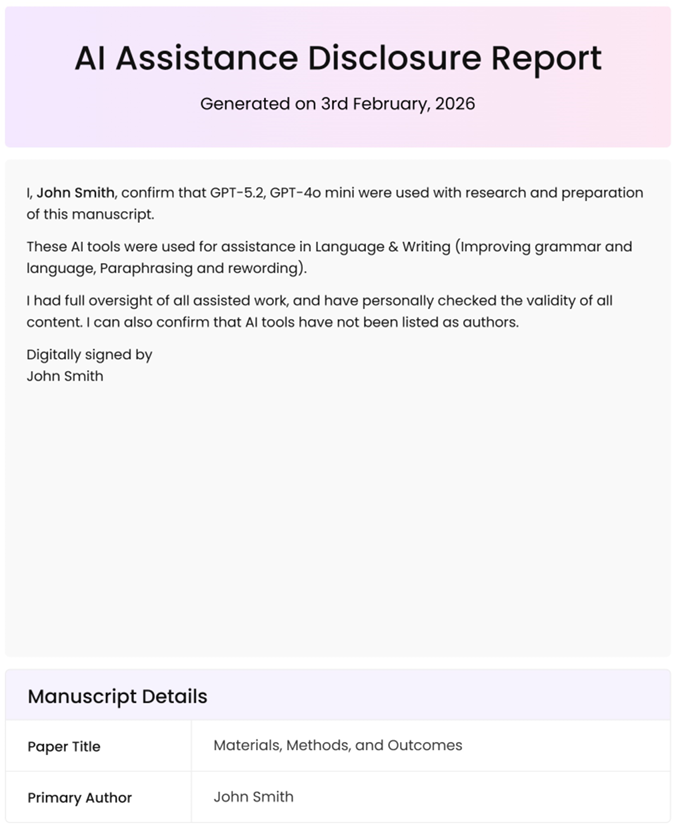

02記録と開示

原稿を執筆しながら生成AIの使用箇所と目的を記録しておくとよいでしょう。ツールとのやりとり(プロンプトと回答)を保存することで、AI使用範囲を正確に申告できるようになります。

03セキュリティと

プライバシー

生成AIツールは様々なデータから学習します。ツールによっては、利用者のアップロードした内容が保存され分析される可能性があります。機密情報以外のコンテンツに限定してください。

出版社が論文執筆者に求めること

学術出版社が論文著者に求めるのは、責任を持ってAIを利用し、生成AIをどの範囲でどう利用したかを申告し、投稿前に全ての内容を人の目で確認することです。ここでは、著者の皆様が、こうした要件に応えるため無料で使えるツールをご紹介します。

01出版社ガイドライン

への準拠

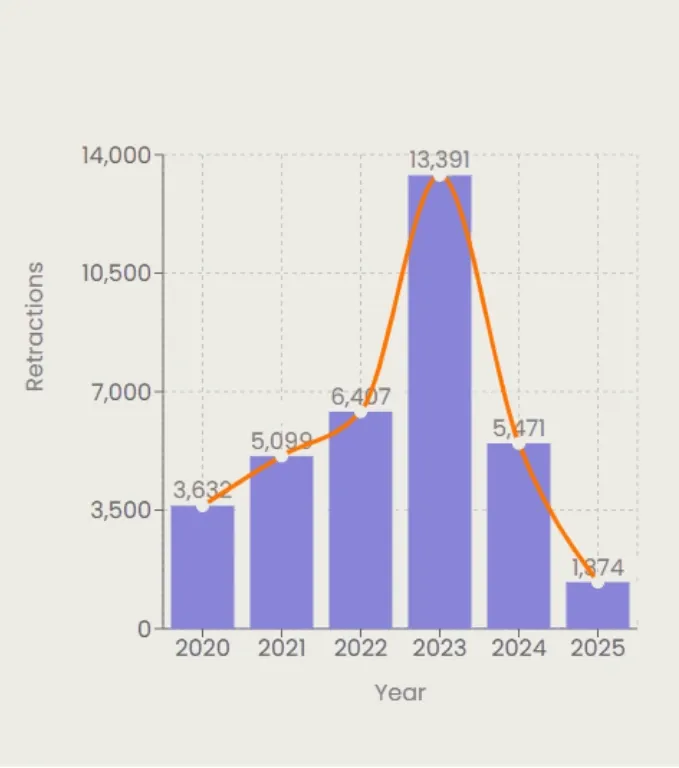

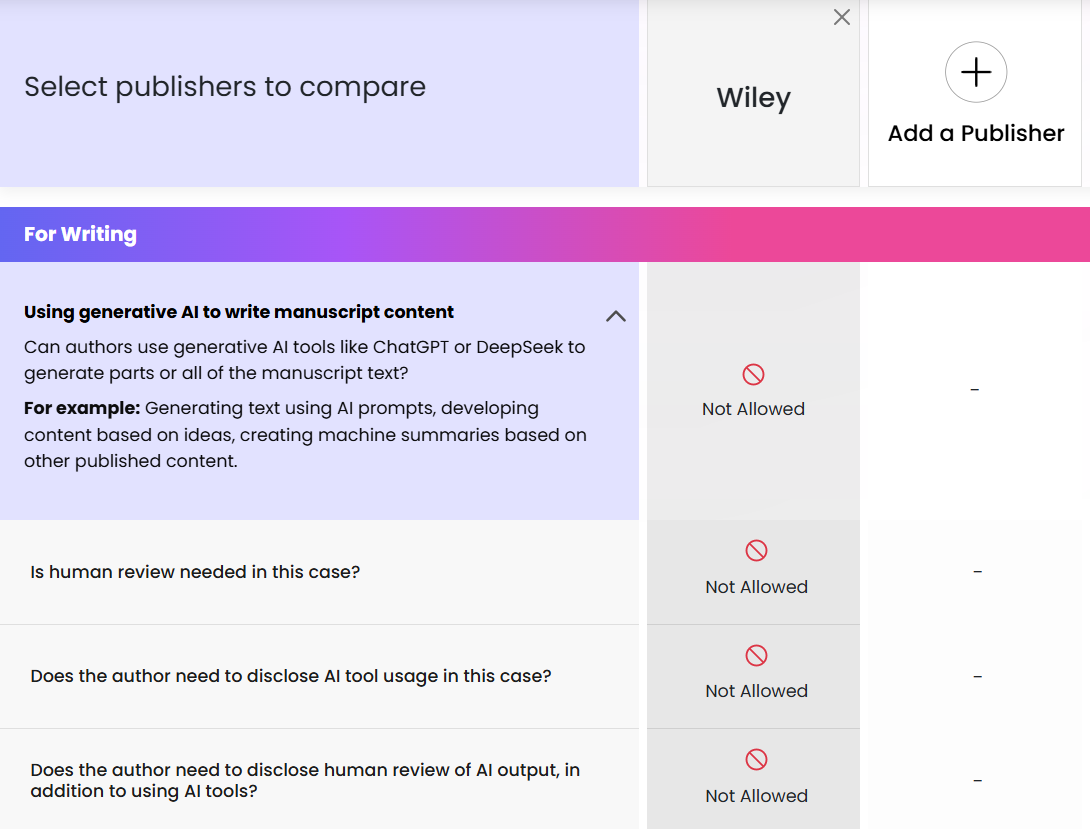

世界中の学術出版社がAI使用に関するガイドラインを発表しています。しかしそれらを個々の研究にあてはめ、実行可能な項目に分解するには手間が掛かります。

出版社ガイドラインのまとめでは、主要20社のポリシーをカテゴリーごとに確認できます。

まとめを見る

02AI使用に関する情報開示

多くの出版社は、ChatGPT、Claude、Geminiなど、生成AIツールをどこで、何のために、どの程度利用したかについての詳細な情報を示す文書の提出を著者に求めます。

生成する

03人間によるチェック/

レビュー

大手学術出版社や多くの大学では、投稿論文やレポートの、人間による事前チェックを義務付けています。

著者自身、あるいは同僚や専門家といったしかるべき人物が、論文の意味や本質が改変されていないことを確認した上で、投稿しなければならないのです。

チェック・確認を行う、レビュアーに求められるのは、その分野の専門知識と、論文の言語の言語能力です。

必要な理由

研究者のための

ワークショップ

エナゴでは、研究者の皆様に責任ある倫理的なAI利用を行っていただけるよう、大学や研究機関等の組織に向けた実践的なワークショップも開催しています。

受講のお問い合わせ